ในช่วงดึกของวันที่ 18 ธันวาคมที่ผ่านมา ‘9Arm’ ยูทูปเบอร์ชื่อดังด้านไอที ได้มีการโพสต์ข้อความลงบน Facebook ส่วนตัวพร้อมแคปภาพข้อความดังกล่าวที่มีคนอ้างว่า

“รู้เท่าทันมิจฉาชีพที่จ้องจะโคลนเสียงเราด้วย AI Voice Cloning”

ซึ่งงานนี้ก็ดูเหมือนว่า 9Arm จะไม่เห็นด้วยโดยให้เหตุผลว่าการที่จะโคลนนิ่งเสียงด้วย AI นั้นมีขั้นตอนที่เยอะและใช้เวลานาน รวมถึงมีความซับซ้อนเกินกว่าการที่มิจฉาชีพจะเลือกใช้วิธีนี้ในการทำเพื่อหลอกให้เหยื่อตายใจ โดย 9Arms กล่าวว่า “เทียบกับผมเอาเวลาหมดนั่นไปไล่โทรเรื่อยๆ อาจจะได้เหยื่อเยอะกว่า”

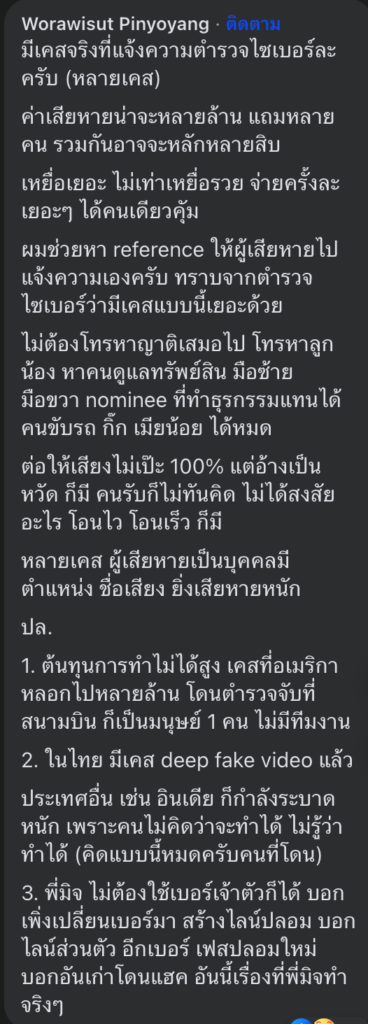

อย่างไรก็ดี คุณ Worawisut Pinyoyang เจ้าของเพจถอดรหัสธุรกิจ , ที่ปรึกษาด้าน AI สำหรับธุรกิจและองค์กร ได้มีคอมเม้นต์ตอบกลับ 9Arm ว่า:

“มีเคสจริงที่แจ้งความตำรวจไซเบอร์ละครับ (หลายเคส) ค่าเสียหายน่าจะหลายล้าน แถมหลายคน รวมกันอาจจะหลักหลายสิบ เหยื่อเยอะ ไม่เท่าเหยื่อรวย จ่ายครั้งละเยอะๆ ได้คนเดียวคุ้ม

ผมช่วยหา reference ให้ผู้เสียหายไปแจ้งความเองครับ ทราบจากตำรวจไซเบอร์ว่ามีเคสแบบนี้เยอะด้วย

ไม่ต้องโทรหาญาติเสมอไป โทรหาลูกน้อง หาคนดูแลทรัพย์สิน มือซ้าย มือขวา nominee ที่ทำธุรกรรมแทนได้ คนขับรถ กิ๊ก เมียน้อย ได้หมด

ต่อให้เสียงไม่เป๊ะ 100% แต่อ้างเป็นหวัด ก็มี คนรับก็ไม่ทันคิด ไม่ได้สงสัยอะไร โอนไว โอนเร็ว ก็มี

หลายเคส ผู้เสียหายเป็นบุคคลมีตำแหน่ง ชื่อเสียง ยิ่งเสียหายหนัก

ปล. 1. ต้นทุนการทำไม่ได้สูง เคสที่อเมริกา หลอกไปหลายล้าน โดนตำรวจจับที่สนามบิน ก็เป็นมนุษย์ 1 คน ไม่มีทีมงาน

2. ในไทย มีเคส deep fake video แล้ว

ประเทศอื่น เช่น อินเดีย ก็กำลังระบาดหนัก เพราะคนไม่คิดว่าจะทำได้ ไม่รู้ว่าทำได้ (คิดแบบนี้หมดครับคนที่โดน)

3. พี่มิจ ไม่ต้องใช้เบอร์เจ้าตัวก็ได้ บอกเพิ่งเปลี่ยนเบอร์มา สร้างไลน์ปลอม บอกไลน์ส่วนตัว อีกเบอร์ เฟสปลอมใหม่ บอกอันเก่าโดนแฮค อันนี้เรื่องที่พี่มิจทำจริงๆ”

แต่ 9Arm ก็ตอบกลับ ซึ่งตัว 9Arm เข้าใจว่ามีการโทรไปล่อลวงอยู่จริง แต่ว่าการโทรไปล่อโดยการเทรน AI นั้นมีจำนวนเท่าไรจากเคสทั้งหมด

“ผมขอ reference ว่าเคสไหนมาจากการดูดเสียงผ่านโทรศัพท์เพื่อไปเทรน AI จริงๆในไทยหน่อยครับ

ผมไม่เถียงว่ามีการโทรไปหลอกจริง แต่ขอให้ยกตัวอย่างเคสที่ทราบแน่ๆแล้วว่าโทรไปเพื่อบันทึกเสียงมาเทรน AI น่ะครับ คือเอาจริงๆ ถ้าจะโทร ผมคิดว่าไม่ต้องเทรน AI ก็ได้ครับ แค่เลียนเสียงด้วยตัวเองก็หลอกได้แล้ว” 9Arms กล่าว

อย่างไรก็ตามการโดนมิจฉาชีพโทรไปหลอก จนทำให้เหยื่อเกิดความสูญเสียขึ้นนั้นกำลังแพร่ระบาดอยู่ในปัจจุบันแต่ถึงอย่างนั้นการโดนหลอกในครั้งนั้นอาจจะไม่ได้เกิดมา AI เรื่องนี้เราคงยังต้องรอดูกันต่อไปอย่างระมัดระวังว่า เจ้าตัว AI Voice Cloning กำลังแพร่ระบาดในแวดวงมิจฉาชีพจริง ๆ หรือไม่

ที่มา: facebook