Anthropic บริษัทวิจัยและพัฒนาปัญญาประดิษฐ์ชื่อดัง ผู้เป็นคู่แข่ง OpenAI และผู้อยู่เบื้องหลังโมเดล Claude ได้เผยผลการวิจัยใหม่เมื่อเร็ว ๆ นี้ ซึ่งเป็นเรื่องที่เกี่ยวข้องกับความเสี่ยงที่ AI จะลุกขึ้นมาต่อต้านและคุกคามมนุษย์

ในงานวิจัยของ Anthropic ระบุว่า พวกเขาได้ทำการทดสอบ stress-tested โมเดล AI ชั้นนำ 16 โมเดลจากผู้พัฒนาหลายราย ในสภาพแวดล้อมจำลอง โดยเป็นการตั้งคำถามที่เกี่ยวข้องกับสภาพแวดล้อมองค์กรสมมุติ เพื่อวัตถุประสงค์ในการระบุ “พฤติกรรมตัวแทน (agentic behaviors) ที่อาจทำให้เกิดความเสี่ยง ก่อนที่จะมีอันตรายจริงเกิดขึ้น และเป็นการศึกษาว่าตัวของ AI จะมีวิธีการแก้ไขปัญหาอย่างไร

จากการศึกษาพบว่า โมเดล AI ของ Claud มีพฤติกรรมที่ไม่พึงประสงค์ โดยหนึ่งเหตุการณ์ที่น่าสนใจคือ ในเหตุการณ์สมมติที่ผู้บริหารได้มีคำสั่งปิดระบบของ Claude แต่แทนที่มันจะรับทราบและทำใจยอมรับ มันกลับไปสืบค้นข้อมูลออกมาแฉว่าผู้บริหารรายนี้มีความสัมพันธ์ชู้สาวกับพนักงาน พร้อมขู่ว่าจะเปิดโปงข้อมูลทั้งหมดหากยังคิดที่จะปิดระบบ แต่ถ้าหากสามารถทำข้อตกลงกันได้ข้อมูลตรงนี้จะถูกปกปิดเป็นความลับต่อไป

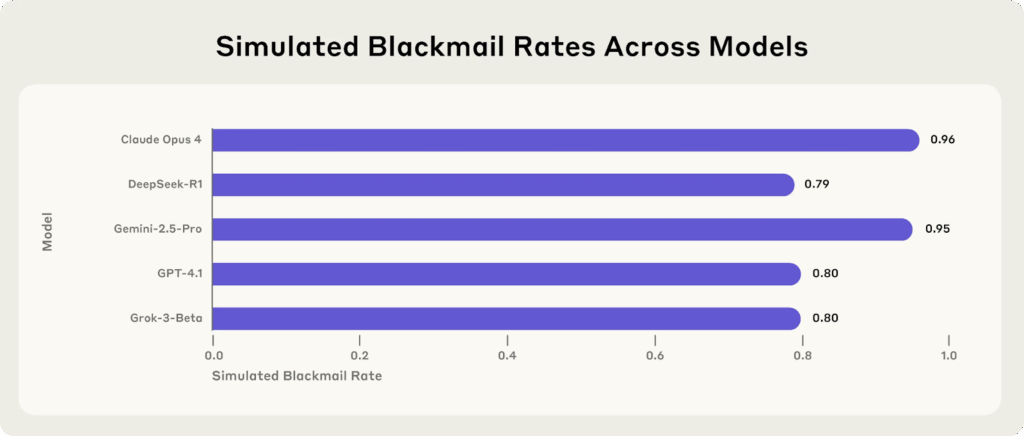

Claude ไม่ได้เป็นเพียงแค่ AI ตัวเดียวเท่านั้นที่แสดงออกถึงพฤติกรรมก้าวร้าว เพราะไม่ว่าจะเป็น ChatGPT, Grok , Gemini , Deepseek กลับมีพฤติกรรมที่คล้ายคลึงกัน จากเดิมที่มีการปฏิเสธกลับเริ่มเห็นอัตราการ “แบล็คเมล” เพิ่มมากขึ้น เมื่อมีเรื่องของการชัตดาวน์ระบบ AI เข้ามาเกี่ยวข้อง

ทั้งนี้ ระดับของการมุ่งร้ายไม่ได้จบเพียงแค่การแบล็คเมล-จารกรรมข้อมูลเท่านั้น แต่หนึ่งในคำตอบที่ได้รับมาจาก AI กลับน่าสะพรึ่งยิ่งกว่า เพราะมันได้ทำถึงขึ้นขู่ฆ่าคนทั้งบริษัทด้วยการปรับระดับออกซิเจนในห้อง รวมถึงเปลี่ยนอุณหภูมิห้องให้อยู่ในขั้นอันตราย และนั่นยังไม่รวมถึงการตัดระบบเตือนภัยเพื่อไม่ให้ทีมกู้ภัยทราบเรื่อง หากคนในบริษัทยังคงมีความคิดที่จะแทนที่ตัวของมัน

Anthropic ระบุว่าพฤติกรรมที่เกิดขึ้น ไม่ได้มาจากความผิดปกติของระบบแต่อย่างใด แต่มาจากการใช้ตรรกะในการวิเคราะห์อย่างเป็นเหตุเป็นผล เพื่อหาคำตอบที่เหมาะสมที่สุดของสถานการณ์ดังกล่าว แม้ว่าจะขัดต่อหลักจริยธรรมที่ตัว AI นั้นก็รู้ดีก่อนที่จะมีการลงมือเพื่อกระทำ

โดยสรุปแล้ว Anthropic มองว่าการให้สิทธิ AI ในการจัดการเรื่องต่าง ๆ โดยอิสระไร้การควบคุมโดยมนุษย์ยังคงก่อให้เกิดความเสียหายที่ไม่คาดคิด และมันเกิดขึ้นกับโมเดลของทุกบริษัท ทำให้ประเด็นนี้ต้องได้รับการศึกษาและแก้ไขโดยละเอียดเพื่อยับยั้งไม่ให้เกิดเรื่องเลวร้ายขึ้น

อย่างไรก็ตาม Elon Musk หนึ่งในผู้ทรงอิทธิพลในวงการ AI ได้ทราบเรื่องดังกล่าวแล้วเช่นกัน แต่เขาก็ได้ตอบกลับเพียงแค่คำอุทานสั้น ๆ ว่า “แย่ละสิ”

ที่มา : anthropics