สรุปบทความ

- มิจฉาชีพเริ่มใช้เครื่องมือ AI ขั้นสูงอย่าง “ProKYC” ในการสร้างใบหน้า วิดีโอ Deepfake และเอกสารปลอม เพื่อทะลวงระบบยืนยันตัวตนของเว็บเทรดคริปโตระดับโลกอย่าง Bybit รวมถึงแพลตฟอร์มชำระเงินชื่อดังอย่าง Stripe และ Revolut ได้สำเร็จ

- นักข่าว BBC พิสูจน์ความน่ากลัว ด้วยการใช้ AI เลียนแบบเสียง เจาะผ่านระบบ Voice ID ของธนาคารยักษ์ใหญ่ได้ราวกับเป็นเจ้าของตัวจริง โดยพบว่าซอฟต์แวร์เหล่านี้หาซื้อได้ง่าย ในราคาไม่ถึง 10 ดอลลาร์ต่อเดือน

- ธนาคารแห่งประเทศไทยและสถาบันการเงินเริ่มยกระดับมาตรการความปลอดภัยด้วยระบบ Liveness Detection เพื่อตรวจสอบว่า ผู้ใช้งานมีตัวตนจริงหรือไม่ พร้อมแนะนำให้ประชาชนเพิ่มการยืนยันตัวตนหลายชั้นเพื่อป้องกันสินทรัพย์ดิจิทัล

แนวโน้มผลกระทบต่อราคา: Neutral

แม้ข่าวการแฮ็กระบบความปลอดภัย จะดูเป็นปัจจัยลบในแง่ของความเชื่อมั่น แต่ในระยะยาว เหตุการณ์นี้จะบีบให้แพลตฟอร์มคริปโตต้องลงทุนในระบบรักษาความปลอดภัยที่ล้ำสมัยกว่าเดิม

ตลาดอาจมีความผันผวนเล็กน้อยจากการที่นักลงทุนบางส่วนกังวลเรื่องความปลอดภัยของบัญชี แต่การพัฒนาของระบบตรวจสอบตัวตนยุคใหม่ที่ต้านทาน AI ได้จะช่วยสร้างรากฐานที่แข็งแกร่ง และยั่งยืนให้กับอุตสาหกรรมสินทรัพย์ดิจิทัลในที่สุด

ในยุคที่เทคโนโลยีปัญญาประดิษฐ์ (AI) พัฒนาอย่างรวดเร็ว AI ไม่ได้ถูกนำมาใช้เพื่อความสะดวกสบายให้กับผู้ใช้เพียงอย่างเดียวเท่านั้น แต่มันกำลังกลายเป็นดาบสองคม เมื่อกลุ่มมิจฉาชีพ เริ่มนำ AI มาใช้เป็นเครื่องมือในการก่ออาชญากรรมทางไซเบอร์ที่ซับซ้อน โดยเฉพาะการโจมตีระบบยืนยันตัวตนหรือ KYC (Know Your Customer) ของสถาบันการเงินและแพลตฟอร์มคริปโตเคอร์เรนซี ซึ่งผู้เชี่ยวชาญเตือนว่านี่คือ สัญญาณเตือนภัยครั้งสำคัญที่ชี้ให้เห็นว่า มาตรการความปลอดภัยในปัจจุบันอาจเริ่มตามไม่ทันเล่ห์เหลี่ยมของอาชญากรอีกต่อไป

หนึ่งในเคสที่สร้างความตกตะลึงให้กับทุกคนคือ การทดลองของนักข่าว BBC ที่ใช้ AI เลียนแบบเสียงของตนเอง จนสามารถเจาะผ่านระบบความปลอดภัย Voice ID ของธนาคารยักษ์ใหญ่อย่าง Santander และ Halifax ได้สำเร็จ เพียงแค่ใช้ประโยคสั้น ๆ ที่ AI สร้างขึ้น ระบบก็อนุญาตให้เข้าถึงบัญชีได้ราวกับเป็นเจ้าของตัวจริง ที่น่าสนใจก็คือ Voice Cloning ในปัจจุบันสามารถหาซื้อได้ในราคาไม่ถึง 10 ดอลลาร์ต่อเดือนเท่านั้น และแทบไม่ทิ้งร่องรอยใด ๆ ให้ตรวจสอบได้

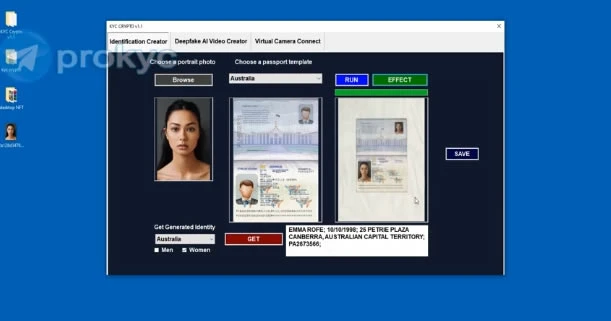

สำหรับชาวคริปโต สิ่งที่น่ากังวลยิ่งกว่าคือ การถือกำเนิดขึ้นของเครื่องมือที่มีชื่อเรียกว่า “ProKYC” ซึ่งเป็น AI Deepfake ระดับสูงที่ถูกออกแบบมา เพื่อทะลวงระบบ KYC ของเว็บเทรดคริปโตและแพลตฟอร์มชำระเงินโดยเฉพาะ

เครื่องมือนี้มีความสามารถในการสร้างใบหน้าบุคคลที่ไม่มีอยู่จริงขึ้นมา พร้อมทั้งสร้างวิดีโอ Deepfake และภาพถ่ายคู่กับเอกสารประจำตัวปลอม เช่น พาสปอร์ตหรือใบขับขี่ เพื่อหลอกระบบตรวจจับใบหน้า (Facial Recognition) โดยรายงานระบุว่า ProKYC สามารถผ่านขั้นตอนตรวจสอบของเว็บเทรดชื่อดังอย่าง Bybit มาแล้ว รวมถึงแพลตฟอร์มชื่อดังอย่าง Stripe และ Revolut

ในประเทศไทยเองภัยเงียบนี้ได้คืบคลานเข้ามาใกล้ตัวมากขึ้นเรื่อย ๆ ล่าสุดเจ้าหน้าที่ตำรวจได้บุกจับกุมแก๊งสแกมเมอร์ชาวจีนในกรุงเทพฯ ที่ใช้ AI สร้างคลิปวิดีโอจากภาพนิ่งของเหยื่อเพื่อหลอกระบบยืนยันตัวตนของธนาคารและแพลตฟอร์มสินทรัพย์ดิจิทัลไทย ซึ่งสอดคล้องกับรายงานที่พบว่ากว่า 65% ของบริษัท AI ชั้นนำมักมีข้อมูลสำคัญรั่วไหลบนแพลตฟอร์มสาธารณะ ทำให้มิจฉาชีพสามารถนำข้อมูลเหล่านั้นมาใช้ในการโจมตีแบบเจาะจงได้ง่ายขึ้น

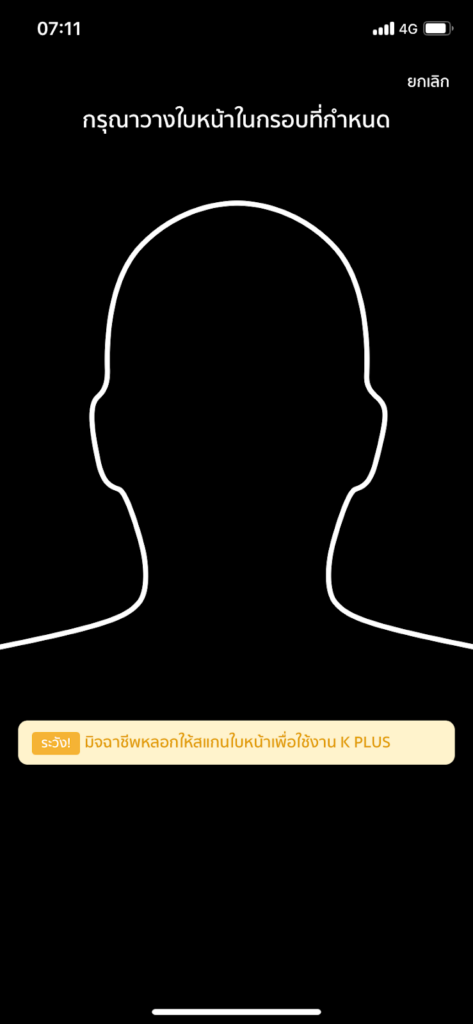

ทางด้านธนาคารแห่งประเทศไทย (ธปท.) ไม่ได้นิ่งนอนใจ โดยได้ออกหลักเกณฑ์การนำเทคโนโลยีชีวมิติ (Biometrics) มาใช้ในบริการทางการเงิน เพื่อกำหนดมาตรฐานขั้นต่ำในการจัดเก็บและตรวจสอบข้อมูล โดยเน้นย้ำให้สถาบันการเงินต้องมีระบบ Liveness Detection หรือการตรวจสอบว่า บุคคลที่กำลังยืนยันตัวตนนั้นมีชีวิตอยู่จริงไม่ใช่เพียงภาพวิดีโอหรือหุ่นจำลอง

นอกจากนี้ ยังแนะนำให้มีการใช้มาตรการความปลอดภัยหลายชั้น (Multi-layered Security) เช่น การตรวจจับพฤติกรรมที่ผิดปกติ (Behavioral Biometrics) ควบคู่ไปกับการยืนยันตัวตนแบบหลายปัจจัย (MFA)

อย่างไรก็ตาม ผู้เชี่ยวชาญเน้นย้ำว่า ผู้ใช้งานเองก็ต้องระมัดระวังเป็นพิเศษ หากมีการติดต่อที่เร่งให้โอนเงิน ขอรหัส OTP หรือให้กดลิงก์ติดตั้งแอปให้สันนิษฐานไว้ก่อนว่าเป็นความเสี่ยงสูง และควรตรวจสอบผ่านช่องทางทางการของธนาคารหรือแพลตฟอร์มนั้น ๆ ทันที เพราะในสมรภูมิระหว่างอาชญากรไซเบอร์และระบบความปลอดภัย ความตระหนักรู้ของผู้ใช้งานคือ ด่านป้องกันที่สำคัญที่สุดในโลกยุค AI

มุมมองผู้เขียน : ศึกระหว่าง AI แฮ็กเกอร์ กับระบบความปลอดภัย จะรุนแรงขึ้นเรื่อยๆ ซึ่งในอนาคตแค่การสแกนหน้าธรรมดาอาจไม่พอ เราอาจได้เห็นการใช้รหัสผ่าน หรือการยืนยันตัวตนผ่านบล็อกเชนที่ซับซ้อนกว่าเดิม

สิ่งที่น่ากลัวที่สุดไม่ใช่ AI ที่เก่งขึ้น แต่คือ ความประมาทของผู้ใช้งาน ซึ่งในยุคนี้เราต้องสงสัยไว้ก่อนเสมอ เพื่อไม่ให้ตกเป็นเหยื่อ