สรุปข่าว

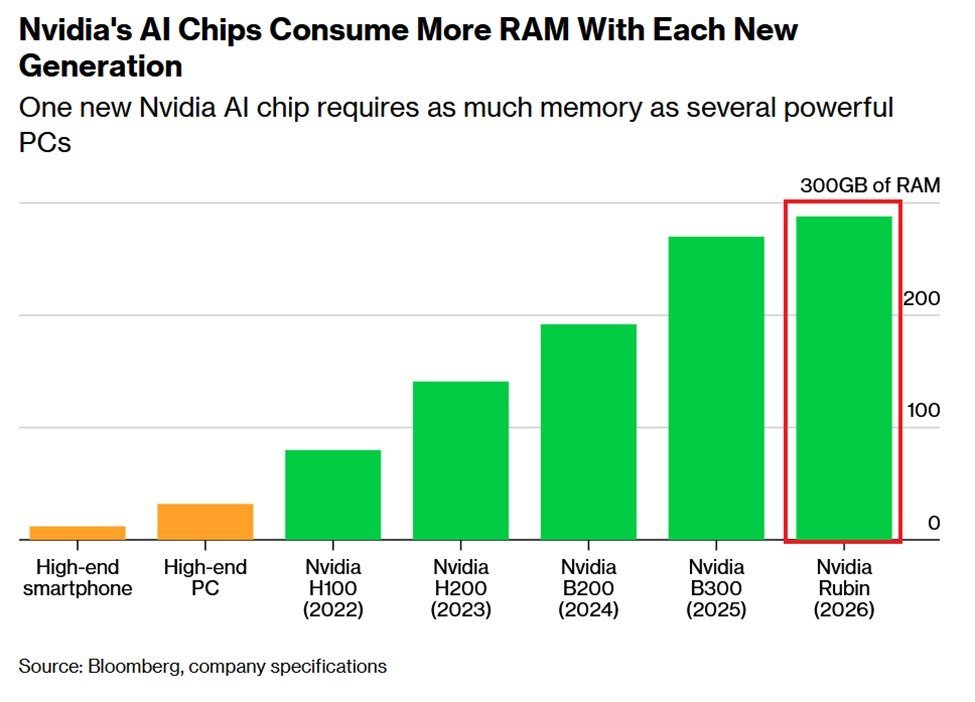

- ชิป AI รุ่น Rubin ล่าสุดของ Nvidia ต้องการ RAM สูงถึง 288GB ซึ่งมากกว่า PC สเปกสูงถึง 800% และมากกว่าสมาร์ทโฟนระดับท็อปถึง 2,300%

- เมื่อเทียบกับชิป H100 ที่เปิดตัวเมื่อ 4 ปีก่อน ความต้องการหน่วยความจำของชิป AI พุ่งขึ้นอย่างก้าวกระโดด สะท้อนการเติบโตของอุตสาหกรรม AI อย่างรวดเร็ว

- แนวโน้มนี้ชี้ให้เห็นว่าการแข่งขันด้านโครงสร้างพื้นฐาน AI ยังคงเร่งตัวต่อเนื่อง ส่งผลให้ความต้องการชิปและหน่วยความจำความเร็วสูงพุ่งสูงขึ้นอีก

แนวโน้มผลกระทบต่อราคา: Neutral

ข่าวนี้เป็น Viral tech stat ที่น่าสนใจและสะท้อนการเติบโตของอุตสาหกรรม AI แต่ไม่ได้ส่งผลกระทบโดยตรงต่อตลาดคริปโต อย่างไรก็ตาม กระแส AI ที่ยังร้อนแรงอาจหนุนความสนใจในโทเคนที่เกี่ยวข้องกับ AI และ DePIN ในระยะยาวได้

ตามรายงานจาก The Kobeissi Letter ชิป AI รุ่นล่าสุดของ Nvidia ที่มีชื่อว่า Rubin ต้องการหน่วยความจำ (RAM) สูงถึง 288GB ซึ่งมากกว่า PC สเปกสูงถึง 800% และมากกว่าสมาร์ทโฟนระดับท็อปถึง 2,300% ข้อมูลนี้เผยแพร่ในช่วงเช้าของวันที่ 8 มี.ค. 2569 และได้รับความสนใจอย่างกว้างขวางในหมู่นักลงทุนและผู้ติดตามวงการเทคโนโลยี ตัวเลขดังกล่าวสะท้อนให้เห็นว่าความต้องการด้านโครงสร้างพื้นฐาน AI กำลังพุ่งสูงขึ้นในอัตราที่ผู้บริโภคทั่วไปยากจะจินตนาการได้ และวางตำแหน่ง Nvidia ไว้ในฐานะผู้ที่ได้ประโยชน์โดยตรงจากการแข่งขันพัฒนา AI ระดับโลก

ความต้องการหน่วยความจำของชิป AI พุ่งขึ้นอย่างก้าวกระโดด

เมื่อ 4 ปีที่แล้ว ชิป H100 ของ Nvidia ถือเป็นมาตรฐานระดับสูงสุดของวงการ AI แต่เมื่อเทียบกับ Rubin รุ่นใหม่ที่ต้องการ RAM ถึง 288GB ช่องว่างระหว่างชิป AI กับอุปกรณ์ที่ผู้บริโภคใช้ทั่วไปก็ยิ่งถ่างกว้างออกไปอย่างรวดเร็ว PC สเปกสูงระดับเกมมิ่งทั่วไปในปัจจุบันมักมี RAM อยู่ที่ 32GB หรือสูงสุดราว 64GB ขณะที่สมาร์ทโฟนรุ่นท็อปอย่าง iPhone หรือ Android เรือธงก็ยังคงอยู่แค่ระดับ 12-16GB เท่านั้น

ความต้องการ RAM ที่พุ่งสูงขึ้นนี้ไม่ใช่เรื่องบังเอิญ แต่เป็นผลโดยตรงจากขนาดของโมเดล AI ที่ใหญ่ขึ้นเรื่อยๆ โดยเฉพาะ Large Language Model (LLM) และโมเดลสำหรับงาน Multimodal ที่ต้องประมวลผลข้อมูลทั้งภาพ ข้อความ และเสียงพร้อมกันในคราวเดียว ยิ่งโมเดลใหญ่ขึ้น ยิ่งต้องการหน่วยความจำมากขึ้นตามไปด้วย และแนวโน้มนี้ยังไม่มีสัญญาณว่าจะชะลอตัวในเร็วๆ นี้

บริษัทเทคโนโลยียักษ์ใหญ่แข่งกันลงทุนโครงสร้างพื้นฐาน AI ไม่หยุด

ตัวเลขความต้องการ RAM ของชิป Rubin สะท้อนภาพรวมของการแข่งขันที่ดุเดือดในวงการ AI ปัจจุบัน บริษัทเทคโนโลยีรายใหญ่ทั้ง Microsoft, Google, Meta และ Amazon ต่างทุ่มงบประมาณมหาศาลเพื่อสร้างดาต้าเซ็นเตอร์และซื้อชิป AI ล็อตใหม่ล่าสุดให้ได้มากที่สุด ซึ่งทำให้ Nvidia กลายเป็นหนึ่งในบริษัทที่มีมูลค่าสูงที่สุดในโลกในช่วงหลายปีที่ผ่านมา

ในมุมของวงการคริปโต กระแสการลงทุนด้าน AI ที่ยังคงร้อนแรงอยู่นี้มีนัยน่าสนใจต่อโทเคนที่เกี่ยวข้องกับโครงสร้างพื้นฐาน AI และ DePIN (Decentralized Physical Infrastructure Network) เนื่องจากนักพัฒนาบางส่วนมองหาทางเลือกในการประมวลผลแบบกระจายศูนย์เพื่อลดต้นทุนและลดการพึ่งพาผู้ให้บริการรายเดียว ถึงแม้ว่าผลกระทบโดยตรงต่อราคา Bitcoin หรือ Ethereum จะยังไม่ชัดเจน แต่เทรนด์นี้ก็ช่วยตอกย้ำว่าความต้องการด้านการประมวลผลในโลกยุค AI กำลังโตเร็วกว่าที่หลายคนคาดไว้

ส่วนตัวผู้เขียนมองว่าตัวเลข 288GB นี้แปลกใจน้อยกว่าที่คิด เพราะโมเดล AI มันโตเร็วมากจริงๆ และสิ่งที่น่าจับตามองมากกว่าตัวเลขนี้คือผลกระทบต่อต้นทุนของผู้ที่ต้องการรัน AI ขนาดใหญ่เอง ในแง่ของคริปโต โทเคนในกลุ่ม AI และ DePIN อาจได้อานิสงส์ถ้าบริษัทหรือนักพัฒนาหันมาสนใจทางเลือกแบบกระจายศูนย์มากขึ้น แต่ก็ยังต้องรอดูว่ามันจะแปลงเป็นดีมานด์ที่จับต้องได้จริงหรือเปล่า สิ่งที่ควรติดตามต่อคือ Nvidia จะเปิดตัว Rubin อย่างเป็นทางการเมื่อไหร่ และราคาต่อหน่วยจะอยู่ที่เท่าไหร่ เพราะนั่นจะบอกได้ว่าใครในโลกนี้จะเข้าถึงมันได้จริง

ภาพจาก AI